端侧 RAG 应用 指南

介绍

本指南适用于基于 AidGen 和 AidGenSE 构建的端侧 RAG(Retrieval-Augmented Generation)应用,该应用结合了 本地大模型推理 与 向量数据库检索,通过UI服务进行交互。

支持情况

硬件支持情况

| SoC (Processor Model) | Linux Support | Android Support |

|---|---|---|

| QCS8550 | ✅ | ✅ |

| 7+ Gen 3 | ❌ | ✅ |

| 8 Gen 2 | ❌ | ✅ |

💡注意

Android 中部署使用大模型需要通过 AidLux 融合系统。

向量知识库支持情况

| 知识库名称 | 使用 Embedding Model |

|---|---|

| 特斯拉使用手册 | BAII/bge-large-zh-v1.5 |

| 汽车维修手册 | BAII/bge-large-zh-v1.5 |

安装部署

安装 AidLux APP(Linux 可跳过)

AidLux APP 是一个精简最小化版的应用,请联系阿加犀技术支持获取安装包。

大模型环境部署

💡注意

Android 环境需在 AidLux APP 的命令行中执行下列指令;你也可以通过拷屏方式在电脑端访问安卓界面,具体参考“常见问题”。

工具安装

# 下载 aidllm 安装包

wget https://aidllm.aidlux.com/files/aidllm_2.1.0_arm64.aid.gpg

# 安装 aidllm

sudo aid-pkg -i -d aidllm_2.1.0_arm64.aid.gpg

# 安装 aidgen-sdk

sudo aid-pkg -i aidgen-sdk

# 下载 aid-open-api 安装包

wget https://aidllm.aidlux.com/files/aid-openai-api_2.0.0_arm64.aid.gpg

# 安装 aid-openao-api

sudo aid-pkg -i -d aid-openai-api_2.0.0_arm64.aid.gpg💡注意

无法找到或安装 aidgen-sdk,对应平台未支持。

支持的模型查询

aidllm remote-list api示例输出:

Current Soc : 8550

Name Url CreateTime

----- --------- ---------

aplux_deepseekr1-1.5B aplux/aplux_deepseekr1-1.5B 2025-03-05 14:51:23

aplux_qwen2-1.5B aplux/aplux_qwen2-1.5B 2025-03-05 14:52:03

...模型下载与加载

# 下载指定模型

aidllm pull api aplux/aplux_qwen2-7B

# 查看本地模型

aidllm list api

# 加载本地模型

aidllm start api -m aplux/aplux_qwen2-7BUI 服务部署

💡注意

Android 环境下,请通过 AidLux APP 使用 IP:8000 的方式访问 Linux 环境。

# 安装 UI 服务

sudo aidllm install uiRAG 服务部署指南

部署准备

- 使用

aidllm login登录前需注册 Aidlux 账号,才能访问远程RAG知识库模型和下载资源。 - 当前支持下载:

- 公开的 RAG 模型

- 用户在 Aidllm-CMS 中自建的私有 RAG知识库模型

- 用户使用Aidllm处于未登录状态下可直接查看和下载公开的RAG知识库,登录后可以查看下载私有的RAG知识库。

用户登录

用户登录使用 RAG 下载、模型管理等功能。

aidllm login登录 Aidllm 服务,认证信息将保存在本地,用于后续命令访问远程资源。

支持的登录方式:

- 交互式用户名/密码输入

- 命令行参数传入

--account - 使用环境变量

AIDLLM_ACCOUNT和AIDLLM_PASSWORD

使用示例:

aidllm login

# 方式 2:指定用户名

aidllm login --account john

# 方式 3:使用环境变量

export AIDLLM_ACCOUNT=john

export AIDLLM_PASSWORD=secret

aidllm login可用参数:

| 参数 | 说明 |

|---|---|

-a, --account | 指定账号名称 |

-h, --help | 查看帮助信息 |

安装 RAG 服务

sudo aidllm install rag查看可用RAG知识库

💡注意

在没有使用aidllm login登录命令的情况下,用户只能查看和下载公共的RAG知识库。

aidllm remote-list rag示例输出:

Public Rag remote list:

Name EmbeddingModel CreateTime

tesla BAAI/bge-large-zh-v1.5 2025-07-25 15:16:53

To get private RAG remote list, please run: aidllm login first登录后可查看用户在 https://aidllm.aidlux.com上创建的私有仓库

Public and Private Rag remote list:

Name EmbeddingModel CreateTime

tesla BAAI/bge-large-zh-v1.5 2025-07-25 15:16:53

testdemo BAAI/bge-large-zh-v1.5 2025-07-24 10:57:02

MyRAG2025 BAAI/bge-large-zh-v1.5 2025-07-21 16:08:14下载指定知识库

aidllm pull rag tesla

aidllm list rag启动服务组件

启动大模型 API 服务

aidllm start api

aidllm start api -m <model_name> # 指定模型启动

aidllm status api # 查看状态

aidllm stop api # 停止服务

aidllm restart api # 重启服务启动 UI 服务

aidllm start ui

aidllm status ui

aidllm stop ui启动 RAG 服务

aidllm start rag

aidllm start rag -n tesla # 启动指定知识库

aidllm status rag

aidllm stop rag访问 Demo 页面

打开浏览器访问:

http://<设备IP>:51104/💡注意

请将 <设备IP> 替换为你的设备 IP 地址。

设置 Demo 开机自启动

在 Linux 上设置:

sudo cp /opt/aidlux/cpf/aidllm/scripts/start_llm.sh /etc/aidlux/在 Android 上设置:

编辑 .bashrc 文件:

vi /root/.bashrc添加以下内容至末尾:

bash /opt/aidlux/cpf/aidllm/scripts/and_start_llm.sh保存后,重启 AidLux App 生效。

手动创建 RAG 知识库并使用 aidllm 运行

一、准备工作

注册账号

访问 aidlux 官网,注册并登录一个 Aidlux 账号。登录 aidllm-cms

打开浏览器访问 https://aidllm.aidlux.com,使用你的 Aidlux 账号登录。

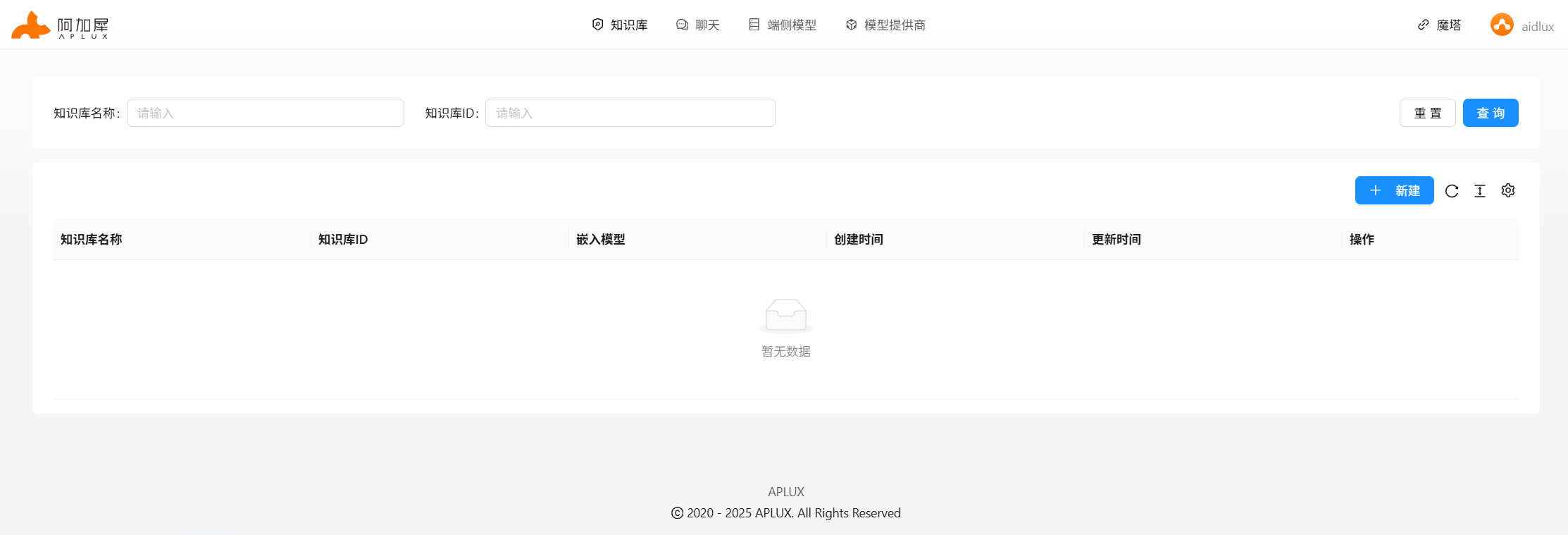

二、创建 RAG 知识库

进入知识库管理界面

登录后点击左侧“知识库”菜单,进入管理页面,点击“新建”。

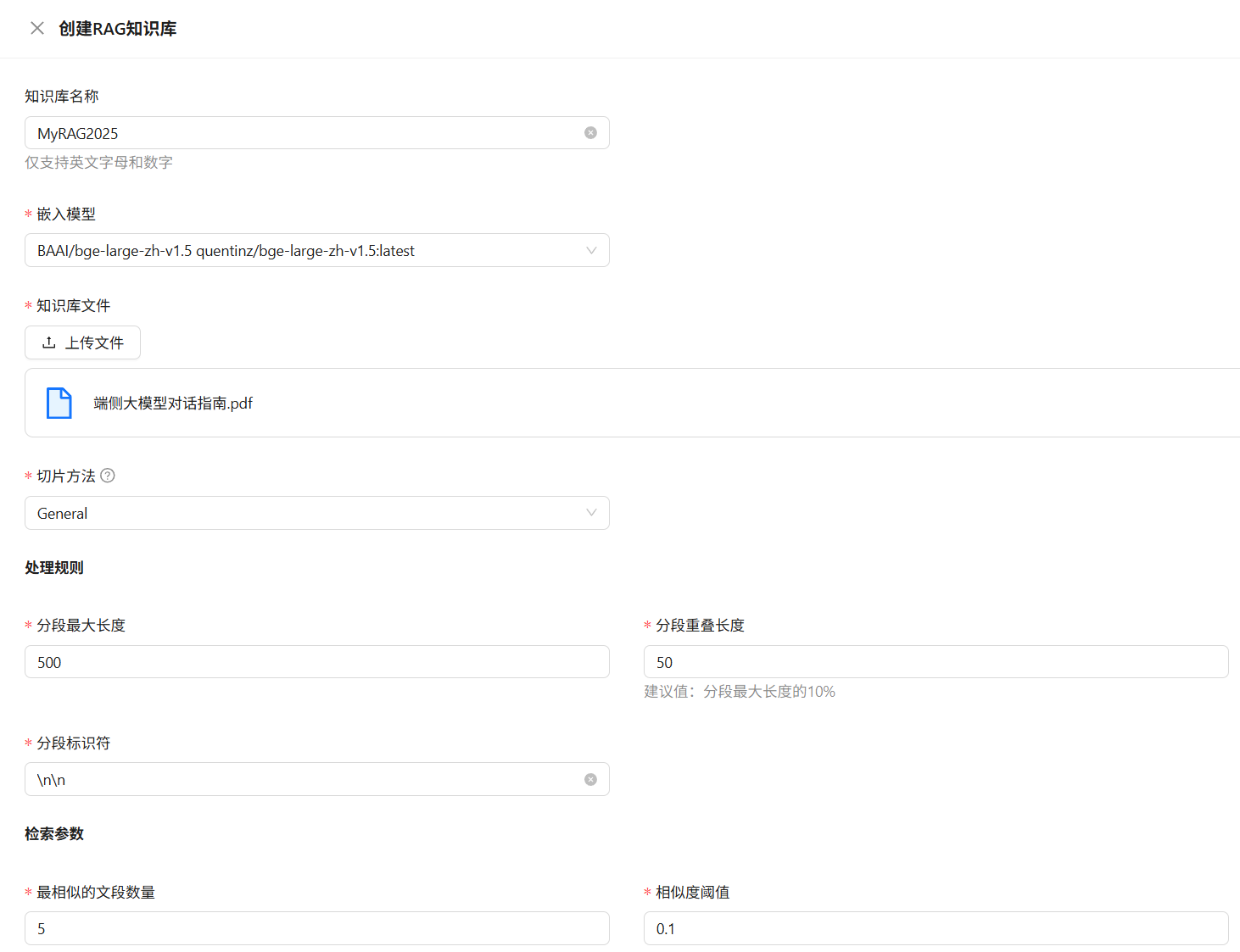

填写知识库信息

名称:仅支持英文字母和数字(如:

MyRAG2025)。嵌入模型:选择当前已加载的 embedding 模型。

切片方法:可选

General或Q&A,具体说明如下:切片方法 支持格式 说明 General文本(.txt / .pdf) 将连续文本按“分段标识符”分割,再按 Token 数量不超过“最大长度”合并为一块。 Q&A.xlsx / .csv / .txt 用于问答格式:Excel 两列(无表头:问题 / 答案);CSV / TXT 使用 Tab 分隔,UTF-8 编码。

注意事项

- 创建的知识库默认仅对自己可见。

- 使用命令行工具时,仅可查看公开知识库及自己创建的私有知识库。

三、命令行操作 aidllm

登录远程 cms

bashaidllm login使用注册的 Aidlux 账号进行登录。

该操作仅用于执行远程知识库相关命令。查看知识库列表

bashaidllm remote-list rag Name EmbeddingModel CreateTime aidluxdocs BAAI/bge-large-zh-v1.5 2025-07-09 14:56:31 MyRAG2025 BAAI/bge-large-zh-v1.5 2025-07-21 16:08:14拉取知识库

bashaidllm pull rag <知识库名称> aidllm pull rag MyRAG2025启动 RAG 服务

bashaidllm start rag Use rag: MyRAG2025 Use model: bge-large-zh-v1.5 Rag server starting... Rag server starting... Rag server starting... Rag server starting... Rag server starting... Rag server starting... Rag server start successfully.成功后本地将开启知识检索服务。

四、运行前准备

确保以下服务模块已正确启动:

| 服务模块 | 说明 |

|---|---|

| LLM API 服务 | 大语言模型推理服务(如 Qwen2.5、ChatGLM 等) |

| RAG 服务 | 本地知识库检索服务,使用 aidllm start rag 启动 |

| UI 服务 | 对话 Web 页面(如 aidlux 提供的对话 UI) |

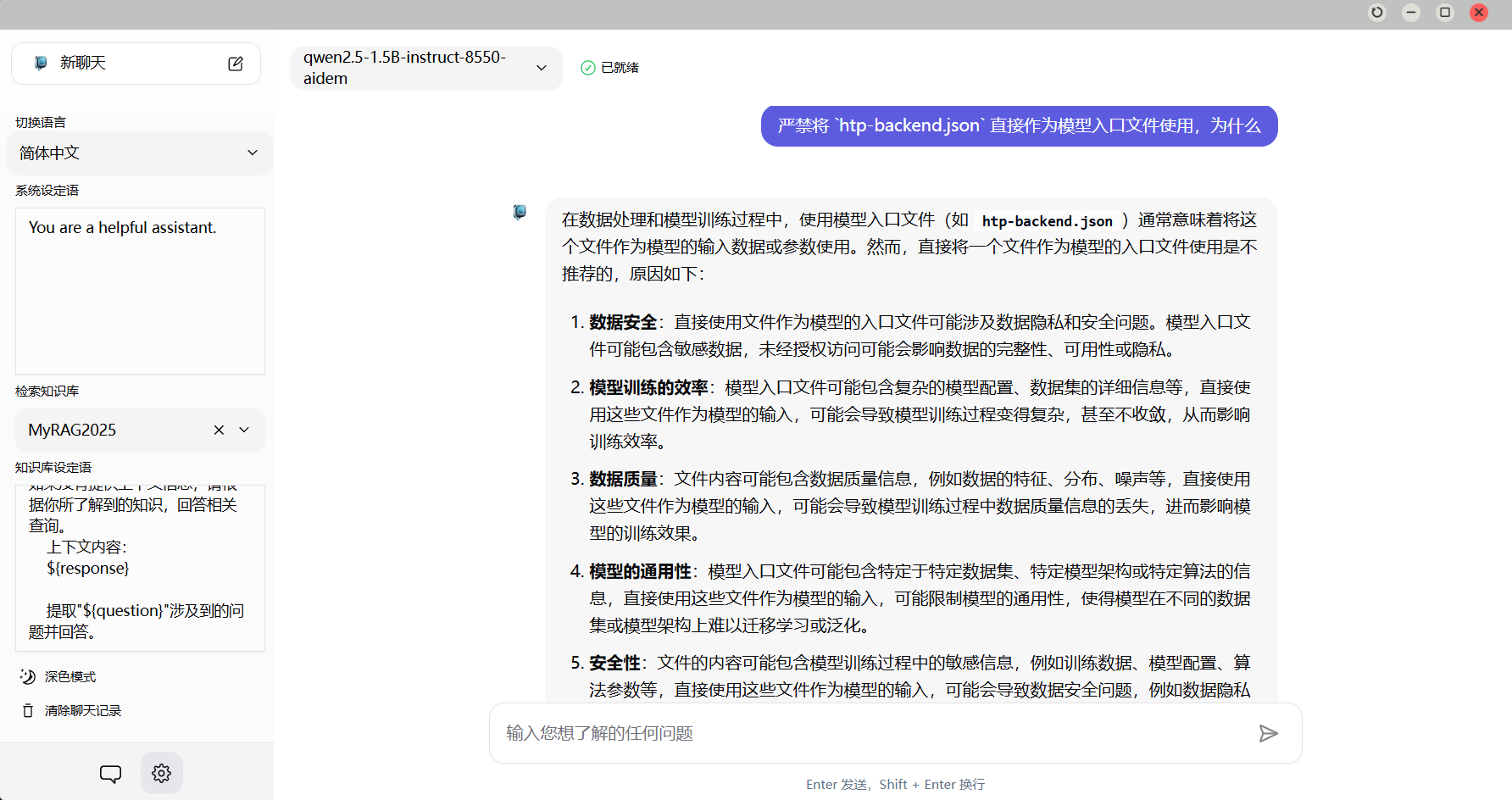

使用Aidllm 提供的 UI 服务可以调用大模型 API,并基于拉取的 RAG 知识库进行问答交互。

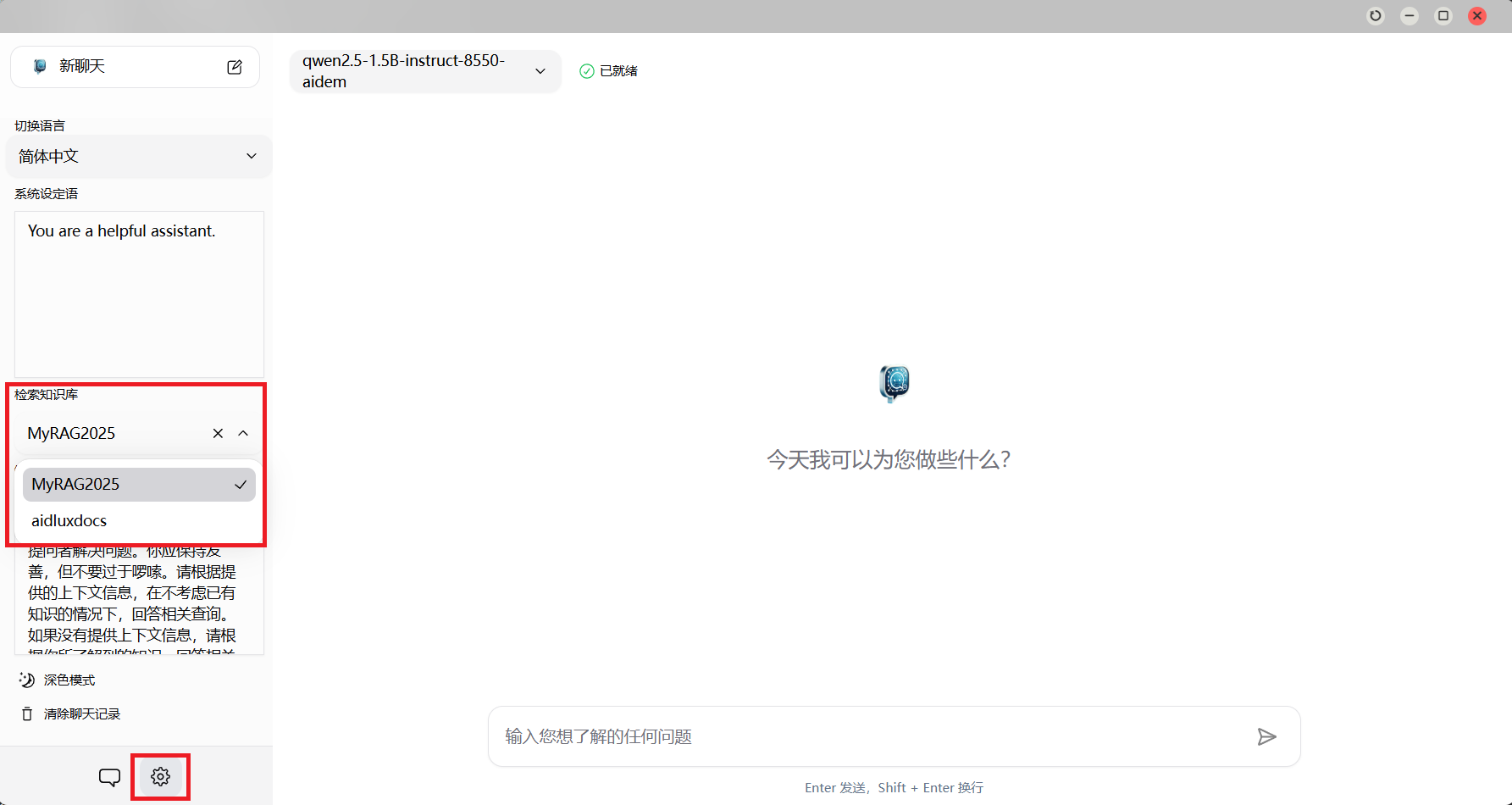

可以通过左下角设置按钮,选择需要检索的RAG知识库。

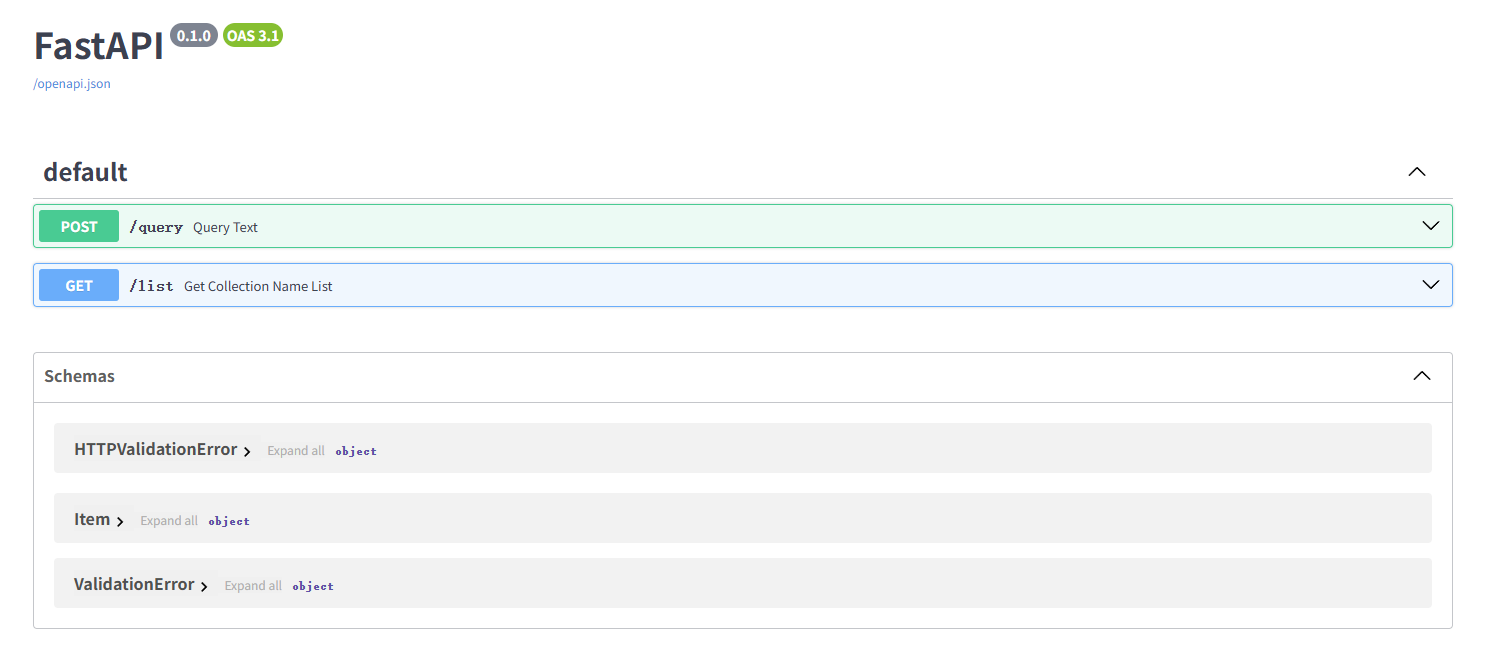

启动 RAG 服务后,可通过以下地址访问 API 文档页面: http://<本机IP>:18111/docs 该页面提供了所有可用的 RAG 接口说明,包括调用方式、请求参数和响应结构,便于开发者集成与调试。

💡 注意

RAG服务默认为:http://<本机>:18111

curl http://<本机IP>:18111/list

curl -X POST http://<本机>:18111/query -H "Content-Type: application/json" -d '{

"text": "xxxx",

"collection_name": "<RAG>",

"top_k": 1,

"score_threshold": 0.1

}'